AIマーケティング自動化の現状と倫理的課題

人工知能(AI)は、マーケティングの世界に革命をもたらし、これまでSFの世界でしか考えられなかった自動化を実現しています。しかし、この強力な技術は、倫理的に問題がある、あるいはリスクの高い戦略への扉を開く可能性も秘めています。

AIによるパーソナライズの落とし穴

AIは、顧客データを分析し、個々のニーズに合わせたパーソナライズされたマーケティング・メッセージを作成することができます。これは、顧客エンゲージメントを高め、コンバージョン率を向上させる強力なツールとなり得ます。しかし、パーソナライズが過度になると、顧客はプライバシーの侵害を感じ、不快感を覚える可能性があります。例えば、顧客がウェブサイトを閲覧した直後に、その商品に関する広告が執拗に表示される場合などが挙げられます。

過度なパーソナライズは、逆効果になるだけでなく、法的問題を引き起こす可能性もあります。個人情報保護法に違反するようなデータの収集や利用は、罰則の対象となることがあります。

自動コンテンツ生成のリスク

AIは、ブログ記事、ソーシャルメディアの投稿、広告コピーなど、さまざまな種類のコンテンツを自動的に生成することができます。これにより、マーケターはコンテンツ制作にかかる時間とコストを大幅に削減できます。しかし、AIが生成したコンテンツは、必ずしも高品質であるとは限りません。不正確な情報や偏った情報が含まれている場合もあります。

また、AIが生成したコンテンツが、著作権を侵害する可能性もあります。既存のコンテンツを無断でコピーしたり、類似したコンテンツを生成したりするAIは、著作権法に違反する可能性があります。

ディープフェイクとマーケティング

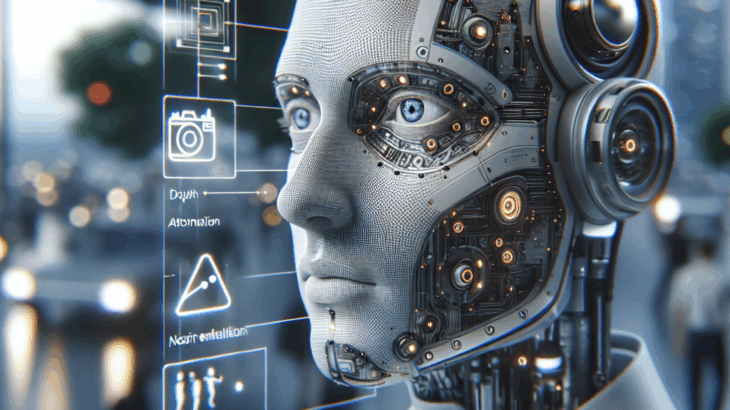

AI技術の進化により、ディープフェイクと呼ばれる、非常にリアルな偽の画像や動画を作成することが可能になりました。マーケターは、ディープフェイクを使って、有名人の推薦広告を作成したり、顧客の購買意欲を刺激するような動画を作成したりすることができます。しかし、ディープフェイクは、顧客を欺き、企業の信頼を損なう可能性があります。

例えば、ある企業が、有名人が自社の商品を推奨するディープフェイク動画を作成したとします。しかし、実際にはその有名人はその商品を推奨しておらず、動画の内容も事実と異なっていた場合、顧客は企業に対して不信感を抱き、ブランドイメージを損なう可能性があります。

AI倫理ガイドラインの必要性

AIマーケティングにおけるリスクを軽減するためには、企業はAI倫理に関する明確なガイドラインを策定する必要があります。このガイドラインには、データの収集と利用に関するルール、コンテンツの品質に関する基準、ディープフェイクの使用に関する制限などが含まれるべきです。

また、従業員に対するAI倫理に関する教育も重要です。従業員は、AI技術の潜在的なリスクを理解し、倫理的な問題が発生した場合にどのように対処すべきかを学ぶ必要があります。

透明性と説明責任

AIマーケティングの透明性を高めることも重要です。顧客は、自分のデータがどのように収集され、利用されているかを知る権利があります。企業は、プライバシーポリシーを明確にし、顧客が自分のデータへのアクセスや修正を要求できるようにする必要があります。

さらに、AIが生成したコンテンツや広告には、それがAIによって作成されたものであることを明示する必要があります。これにより、顧客はAIによって操作されているという感覚を軽減し、企業に対する信頼を維持することができます。

AIマーケティングは、マーケターにとって強力なツールとなり得ますが、同時にリスクも伴います。倫理的なガイドラインを策定し、透明性を高めることで、企業はAIの恩恵を最大限に享受しながら、潜在的なリスクを最小限に抑えることができます。