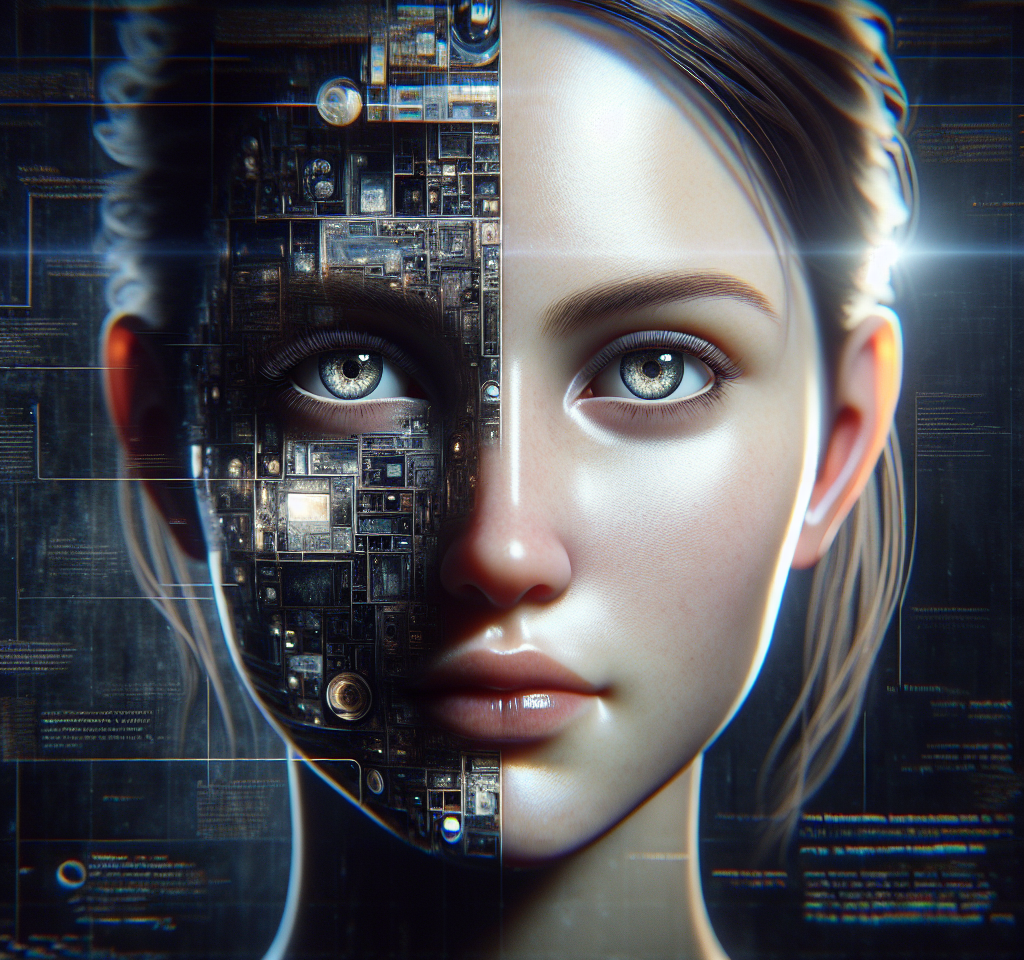

AIマーケティング自動化の裏側:倫理的な落とし穴と創造性のジレンマ

近年、AI(人工知能)技術の進化は、マーケティングの世界に革命をもたらしています。AIマーケティング自動化ツールは、データ分析、コンテンツ生成、顧客エンゲージメントなど、多岐にわたる業務を効率化し、企業はより少ないリソースでより大きな成果を上げられるようになりました。しかし、この進歩の陰には、倫理的な問題や創造性の限界といった、看過できないリスクが潜んでいます。

自動化による効率化の光と影

AIマーケティング自動化は、顧客データを分析し、パーソナライズされたコンテンツを自動生成することで、顧客体験を向上させることができます。これにより、企業は顧客一人ひとりのニーズに合わせた最適なメッセージを、適切なタイミングで届けることが可能になります。しかし、この高度なパーソナライゼーションは、プライバシー侵害のリスクを高める可能性もあります。

倫理的なジレンマ:プライバシー侵害のリスク

AIは、大量の個人データを収集・分析することで、顧客の行動や嗜好を予測します。このデータは、ターゲティング広告やパーソナライズされたコンテンツの作成に利用されますが、データの取得方法や利用目的によっては、プライバシー侵害につながる可能性があります。例えば、顧客が予期しない方法でデータが利用されたり、機密性の高い情報が漏洩したりするリスクがあります。

創造性の限界:AIは独創的なアイデアを生み出せるか?

AIは、既存のデータに基づいてコンテンツを生成することができますが、真に独創的なアイデアを生み出すことは苦手です。AIが生成するコンテンツは、過去のデータパターンを模倣する傾向があり、斬新さや驚きに欠けることがあります。そのため、AIに頼りすぎると、マーケティングキャンペーンが単調になり、顧客の関心を引くことが難しくなる可能性があります。

過激な戦略:炎上マーケティングのリスク

一部の企業は、AIを使って炎上マーケティングと呼ばれる、物議を醸すようなコンテンツを意図的に生成し、注目を集めようとする戦略を取ることがあります。炎上マーケティングは、一時的に話題になるかもしれませんが、ブランドイメージを大きく損なうリスクがあります。特に、倫理的に問題のあるコンテンツや、特定の層を差別するような表現は、社会的な反発を招き、企業の信頼を失墜させる可能性があります。

透明性の欠如:ブラックボックス化するAI

AIの意思決定プロセスは、しばしばブラックボックス化しており、そのロジックが理解しにくい場合があります。特に、複雑なニューラルネットワークを使用している場合、なぜAIが特定の判断を下したのかを説明することが困難です。この透明性の欠如は、AIの偏見や不公正な判断を招く可能性があり、企業はAIの利用において、公平性と透明性を確保するための対策を講じる必要があります。

責任の所在:誰が責任を負うのか?

AIマーケティング自動化によって問題が発生した場合、誰が責任を負うのかという問題が生じます。例えば、AIが不適切なコンテンツを生成し、顧客に損害を与えた場合、責任はAIの開発者にあるのか、それともAIを導入した企業にあるのか、明確な基準はありません。この曖昧さは、問題が発生した際の責任追及を困難にし、企業はAIの利用において、責任の所在を明確にするための対策を講じる必要があります。

まとめ:AIマーケティング自動化の倫理的な課題

AIマーケティング自動化は、効率化やパーソナライゼーションといった多くのメリットをもたらしますが、同時に倫理的な問題や創造性の限界といったリスクも抱えています。企業は、AIの利用において、プライバシー保護、公平性、透明性を重視し、倫理的なガイドラインを策定する必要があります。また、AIに頼りすぎることなく、人間の創造性や判断力を活かすことで、より効果的で倫理的なマーケティング活動を実現することができます。