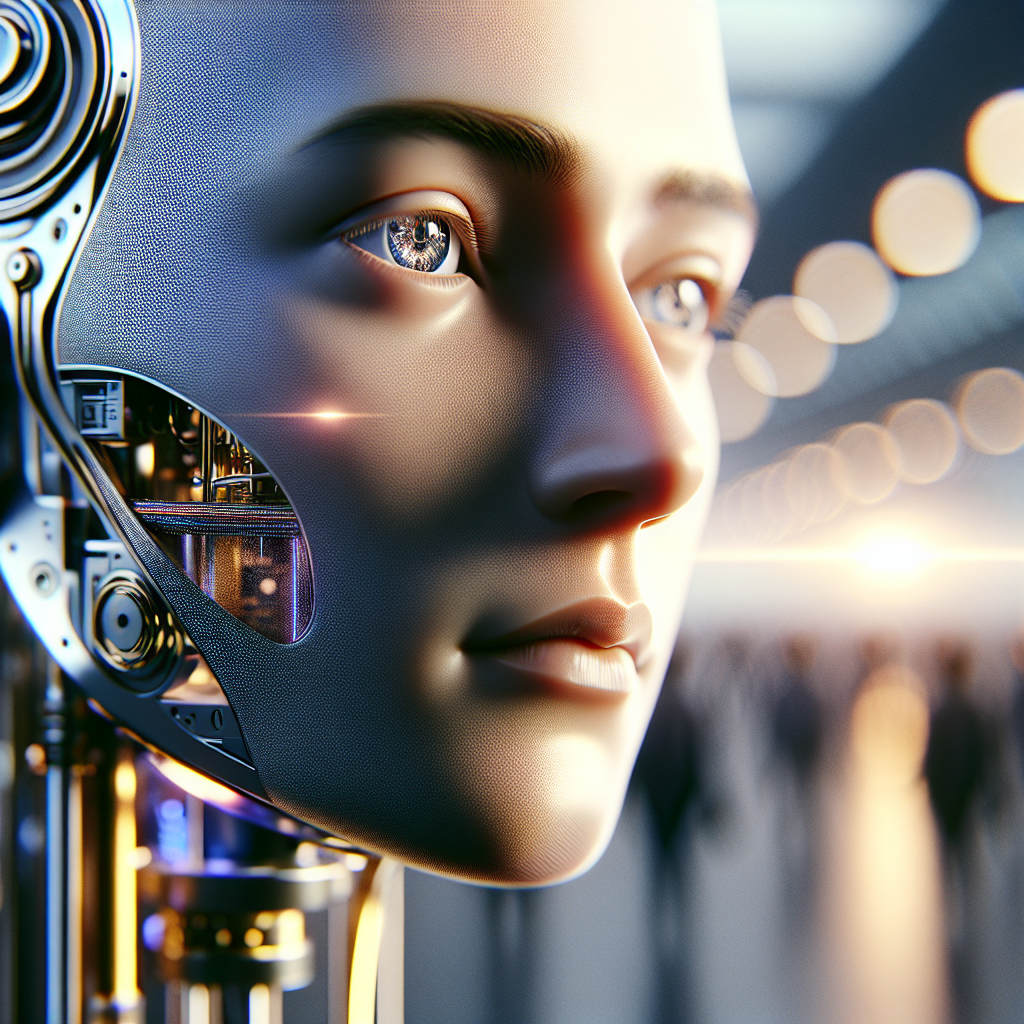

AIマーケティング自動化のグレーゾーン戦略:どこまで許される?

AI(人工知能)はマーケティングの世界に革命を起こし、業務効率化や顧客体験の向上に大きく貢献しています。しかし、AIマーケティング自動化には、倫理的な問題や法的なリスクが伴うことも忘れてはなりません。今回は、AIマーケティング自動化における「ギリギリ」のライン、つまり倫理的に微妙なグレーゾーン戦略に焦点を当て、企業が注意すべきポイントとリスク回避策を解説します。

過度なパーソナライゼーション:プライバシー侵害のリスク

AIは顧客の膨大なデータを分析し、個々のニーズに合わせた高度なパーソナライゼーションを実現します。まるで「あなたのことをすべて知っている」かのような体験は、顧客エンゲージメントを高める一方で、プライバシー侵害に対する懸念も生み出します。例えば、あるECサイトで特定の商品を閲覧した後、別のサイトやSNSで関連商品の広告が執拗に表示されると、顧客は「なぜ私の行動が筒抜けなんだ?」と不快に感じるでしょう。このような過度なリターゲティング広告は、逆効果となり、ブランドイメージを損なう可能性があります。

対策:

- 顧客データの利用目的を明確にし、プライバシーポリシーを分かりやすく提示する。

- 顧客が自身のデータへのアクセス、修正、削除を容易に行える仕組みを提供する。

- GDPR(一般データ保護規則)などの個人情報保護法を遵守する。

自動コンテンツ生成:品質、著作権、倫理の課題

AIはブログ記事、SNS投稿、広告コピーなどを自動生成できます。まるで優秀なコピーライターを雇ったかのように、短時間で大量のコンテンツを作成できるのは大きなメリットですが、その品質は必ずしも保証されません。不正確な情報や著作権侵害のリスクも考慮する必要があります。

対策:

- AIが生成したコンテンツは、必ず人間の目でチェックし、ファクトチェックを徹底する。

- 著作権に関する問題を十分に検討し、必要に応じて権利者の許諾を得る。

- AIが生成したコンテンツであることを明示する。

ディープフェイクの誘惑:信頼崩壊の危険な罠

AI技術の進化により、ディープフェイクを簡単に作成できるようになりました。マーケターはこれを利用して、有名人の推薦広告を制作したり、人々の購買意欲を刺激するような動画を制作したりできます。しかし、ディープフェイクは顧客を欺き、企業の信頼を大きく損なう可能性があります。例えば、実際には推奨していない商品を推奨しているかのように見せかける動画は、顧客の怒りを買い、ブランドイメージを地に落とすでしょう。ディープフェイクの使用は、倫理的に大きな問題があるため、原則として避けるべきです。

対策:

- ディープフェイクの使用は原則として避ける。

- 使用する場合は、それがディープフェイクであることを明示し、顧客に誤解を与えないように最大限の配慮をする。

- 虚偽の情報を拡散する目的でディープフェイクを使用しない。

AI倫理ガイドラインの策定と透明性の確保

AIマーケティングにおけるリスクを最小限に抑えるためには、企業はAI倫理に関する明確なガイドラインを策定する必要があります。データ収集と利用に関するルール、コンテンツの品質に関する基準、ディープフェイクの使用に関する制限などを盛り込むべきです。そして、従業員に対するAI倫理に関する教育は必要不可欠です。

まとめ:倫理観こそがAIマーケティング成功の鍵

AIマーケティングは強力なツールですが、同時にリスクも伴います。倫理的なガイドラインを策定し、透明性を高めることで、企業はAIの恩恵を最大限に享受しながら、潜在的なリスクを最小限に抑えることができるでしょう。AIはあくまでツール。使う側の倫理観が問われる時代なのです。